2. Резкий рост и значительное ускорение подтверждают предположение о возможном приближении к точке сингулярности; в свое время это предвидели математики Джон фон Нейман и Станислав Улам:

Чаще всего мы вели беседы на такие темы, как ускорение технического прогресса и общие перемены, влияющие на образ жизни человека. Наблюдая стремительные изменения, мы понимали, что исторически вся наша гонка неизбежно приведет человечество к некой неустранимой точке; перейдя ее, люди уже не смогут продолжать ту деятельность, к которой мы все так привыкли [Ulam 1958].

3. См.: [Hanson 2000].

4. См.: [Vinge 1993; Kurzweil 2005].

5. См.: [Sandberg 2010].

6. См.: [Van Zanden 2003; Maddison 1999; Maddison 2001; De Long 1998].

7. Два часто повторяемых в 1960-е гг. оптимистичных утверждения: «Через двадцать лет машины смогут выполнять всю работу, которую делают люди» [Simon 1965, p. 96]; «В течение жизни нашего поколения… задача создания искусственного интеллекта будет в целом решена» [Minsky 1967, p. 2]. Системное исследование прогнозов см.: [Armstrong, Sotala 2012].

8. См., например: [Baum et al. 2011; Armstrong, Sotala 2012].

9. По моему предположению, исследователи, работающие в области ИИ, сами не отдают себе отчета, что довольно плохо представляют, сколько времени требуется на его создание; причем данное обстоятельство может сказаться на оценке срока разработки: как в сторону завышения, так и занижения.

10. См.: [Good 1965, p. 33].

11. Одним из немногих, кто выражал беспокойство по поводу возможных результатов, был Норберт Винер, в 1960 году писавший в статье «Некоторые моральные и технические последствия автоматизации» [Wiener 1960]:

Если для достижения собственных целей мы используем некое механическое устройство, на деятельность которого после его запуска уже не в состоянии повлиять, поскольку его действия настолько быстры и небратимы, что информация о необходимости вмешательства у нас появляется, лишь когда они завершатся, то в таких случаях хорошо бы быть полностью уверенными, что заложенная нами в машину цель действительно соответствует нашим истинным желаниям, а не является красочной имитацией.

О тревоге, связанной с возможным появлением сверхразумных машин, рассказал в своем интервью Эд Фредкин [McCorduck 1979]). Ирвинг Гуд продолжал говорить о возможных рисках и, чтобы предотвратить грозящую планете опасность, в 1970 году даже призвал к созданию ассоциации [Good 1970]; в более поздней статье он предвосхитил некоторые идеи косвенной нормативности [Good 1982] (мы их обсудим в главе 13). На принципиальные проблемные вопросы указал в 1984 году Марвин Мински [Minsky 1984].

12. См.: [Yudkowsky 2008a]. На необходимость дать оценку этическим аспектам потенциально опасных будущих технологий прежде, чем они станут реальностью, указывала Ребекка Роуч [Roache 2008].

13. См.: [McCorduck 1979].

14. См.: [Newell et al. 1959].

15. Программы Saints, Analogy и Student соответственно, см.: [Slagle 1963; Evans 1964; Evans 1968; Bobrow 1968].

16. См.: [Nilsson 1984].

17. См.: [Weizenbaum 1966].

18. См.: [Winograd 1972].

19. См.: [Cope 1996; Weizenbaum 1976; Moravec 1980; Thrun et al. 2006; Buehler et al. 2009; Koza et al. 2003]. Первая лицензия на право пользоваться беспилотным автомобилем выдана управлением транспортных средств штата Невада в мае 2012 года.

20. Система STANDUP [Ritchie et al. 2007].

21. Эти слова Хьюберта Дрейфуса как характерный пример общего скептического отношения к предмету обсуждения приводит в своей статье «Пределы искусственного интеллекта» Джекоб Шварц [Schwartz 1987].

22. В то время одним из самых неистовых и ярких противников ИИ считался Хьюберт Дрейфус, но и другие критики были не менее знамениты и заметны, например Джон Лукас, Роджер Пенроуз и Джон Сёрл. Дрейфус, опровергая работы ведущих исследователей, главным образом подвергал сомнению практическую пользу, которую сможет принести существовавшая на тот момент парадигма ИИ (причем, похоже, он не исключал появления более удачных концепций). Сёрл, будучи философом, прежде всего интересовался не инструментальными средствами для разработки ИИ, а тем, как решаются проблемы сознания, в частности, с точки зрения теории функциональных систем. Лукас и Пенроуз в принципе отрицали, что в рамках парадигмы классического компьютера можно разработать программное обеспечение, думающее и дышащее лучше живого математика; однако оба допускали и автоматизацию отдельных функций, и создание таких мощных инструментальных средств, которые в конечном счете приведут к появлению ИИ. И хотя Цицерон в трактате «О прорицании» (De divinatione)[33] заметил, что «нет такого абсурда, который нельзя было бы найти в книгах философов» [Cicero. On Divination, 119], как ни странно, мне трудно вспомнить хотя бы одного серьезного ученого и просто мыслящего человека, отрицавшего возможность создания искусственного интеллекта — в том значении этого термина, который используется в настоящей книге.

23. Однако во многих приложениях процесс обучения нейронных сетей несколько отличается от модели линейной регрессии — статистического метода, разработанного в начале XIX века Адриеном-Мари Лежандром и Карлом Фридрихом Гауссом.

24. Основной алгоритм был описан в 1969 году Артуром Брайсоном и Юй-Чи Хо как многошаговый метод динамической оптимизации [Bryson, Ho 1969]. Применить его к нейронным сетям предложил в 1974 году Пол Вербос [Werbos 1994], но признание у научного сообщества этот метод получил лишь в 1986 году после работы Дэвида Румельхарта, Джеффри Хинтона и Рональда Уильямса [Rumelhart et al. 1986].

25. Ранее было показано, что функциональность сетей без скрытых слоев серьезно ограничена [Minsky, Papert 1969].

26. См., например: [MacKay 2003].

27. См.: [Murphy 2012].

28. См.: [Pearl 2009].

29. Мы сознательно опускаем различные технические подробности, чтобы не перегружать повествование. К некоторым из них будет возможность вернуться в главе 12.

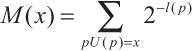

30. Программа p генерирует полное описание строки x, если p, запущенная на (некоторой) универсальной машине Тьюринга U, выдает x; это можно записать как U(p) = x. (Здесь строка x представляет любой возможный мир.) Тогда колмогоровская сложность x равна K(x) = minp {l(p) : U(p) = x}, где l(p) — это длина p в битах. Соломоновская вероятность x определяется как

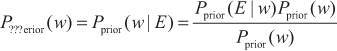

31. Байесово обусловливание с учетом свидетельства Е дает (вероятность утверждения [например, Е] есть сумма вероятностей возможных миров, в которых это утверждение истинно.)

32. Или случайным образом выбирает одно из возможных действий с максимальной ожидаемой полезностью, если их несколько.

33. Более сжато ожидаемая полезность действия может быть записана как

34. См., например: [Howson, Urbach 1993; Bernardo, Smith 1994; Russell, Norvig 2010].

35. См.: [Wainwright, Jordan 2008]. У байесовских сетей бесчисленное количество областей применения; см., например: [Pourret et al. 2008].

36. Возможно, некоторые читатели, сочтя это направление не слишком серьезным, зададут вопрос: зачем уделять столь пристальное внимание компьютерным играм? Дело в том, что игровые интеллектуальные системы, пожалуй, дают самое наглядное представление о сравнительных возможностях человека и машины.